Imagine cada neurônio como uma pequena fábrica:

1. Entrada: Ele recebe várias matérias-primas (os dados de entrada multiplicados pelos pesos).

2. Soma: Ele soma tudo em um grande amontoado (combinação linear).

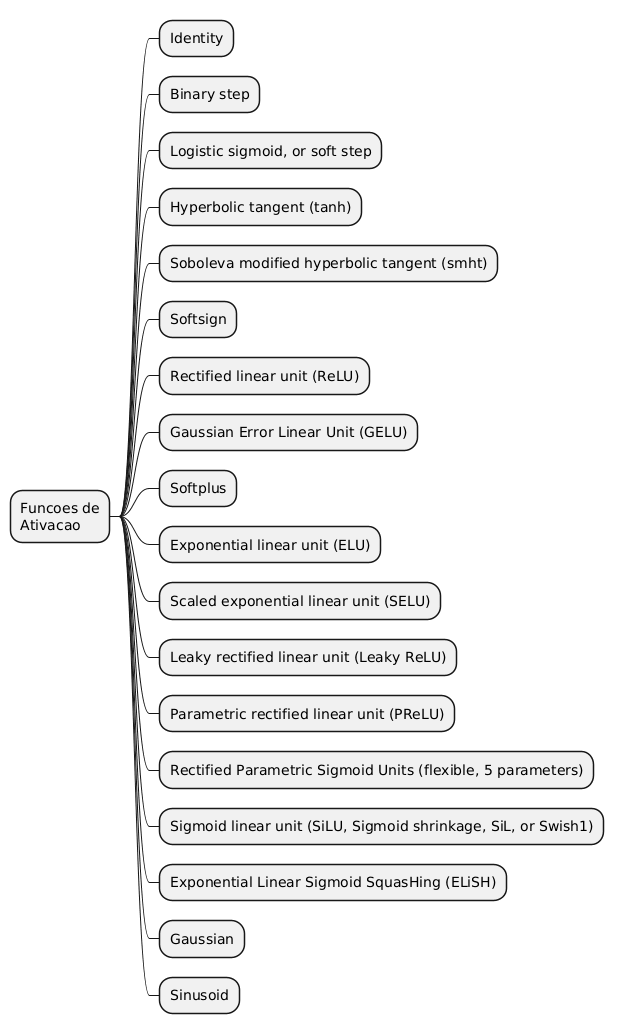

3. Função de Ativação: É a máquina que transforma essa matéria-prima em um produto útil.

Sem essa máquina (função linear), a saída seria apenas uma soma simples. Com ela (função não linear), o neurônio pode produzir resultados complexos, como “ligar” apenas para certos padrões. É a não linearidade que permite às redes neurais aprenderem padrões complexos do mundo real (imagens, sons, textos).

Tabela de Referência Rápida

| Função | Faixa de Saída | Mais Usada Em… | Cuidado / Problema |

|---|---|---|---|

| Sigmoid | (0, 1) | Saída binária; Portas (LSTMs) | Vanishing Gradient |

| Tanh | (-1, 1) | Dentro de LSTMs/GRUs | Vanishing Gradient |

| ReLU | [0, \(\infty\)) | Camadas ocultas (padrão) | Dying ReLU |

| Leaky ReLU | (\(-\infty\), \(\infty\)) | Alternativa à ReLU | Pode ser inconsistente |

| Softmax | (0, 1) | Saída multi-classe exclusiva | Não usar em ocultas |

| Linear | (\(-\infty\), \(\infty\)) | Saída de regressão | Não adiciona não-linearidade |