Atualmente, o ecossistema de machine learning oferece diversas ferramentas especializadas. Principalmente, quatro frameworks destacam-se com propósitos complementares: TensorFlow, PyTorch, Scikit-learn e JAX.

TensorFlow: O Ecossistema Completo

Desenvolvido pelo Google, o TensorFlow estabeleceu-se como uma solução empresarial robusta. Analogamente a uma plataforma industrial, oferece:

- TensorFlow Extended (TFX) para pipelines completos de ML

- TensorFlow Serving para deployment em produção

- TensorFlow Lite para dispositivos móveis e embarcados

- Suporte nativo para TPUs e distribuição eficiente

Conforme a documentação, sua arquitetura baseada em grafos computacionais permite otimizações avançadas. Inegavelmente, é ideal para sistemas que exigem escalabilidade e monitoramento.

PyTorch: A Revolução da Pesquisa

Criado pelo Facebook, o PyTorch transformou o paradigma de desenvolvimento. Similarmente a um laboratório de pesquisa, caracteriza-se por:

- Computação dinâmica (eager execution) por padrão

- Interface pythonica com integração profunda ao Python

- TorchScript para conversão e otimização de modelos

- Ecossistema rico com torchvision e torchaudio

Aliás, sua adoção massiva na academia torna-o padrão para implementação de papers recentes. Surpreendentemente, expandiu rapidamente para ambientes de produção.

Scikit-learn: A Base do ML Tradicional

Diferentemente dos frameworks de deep learning, o Scikit-learn foca em algoritmos clássicos. Primordialmente, destaca-se por:

- API consistente com métodos fit(), predict() e transform()

- Implementações eficientes de algoritmos tradicionais

- Ferramentas completas para pré-processamento e avaliação

- Documentação excepcional e curva de aprendizado suave

Certamente, é a escolha ideal para problemas que não exigem redes neurais profundas. Decerto, serve como excelente ponto de partida para iniciantes.

JAX: O Paradigma da Computação Científica

Também desenvolvido pelo Google, JAX introduz uma abordagem funcional. Principalmente, baseia-se em:

- Transformações composáveis: grad, jit, vmap, pmap

- API familiar similar ao NumPy

- Compilação Just-In-Time com XLA

- Diferenciação automática de alta ordem

Embora seja mais de baixo nível, bibliotecas como Flax e Haiku facilitam o desenvolvimento. Conquanto exija maior expertise, oferece controle e performance incomparáveis.

Diferenças Fundamentais e Aplicações

Enquanto Scikit-learn especializa-se em ML tradicional, os outros três focam em deep learning. Entretanto, suas filosofias divergem significativamente.

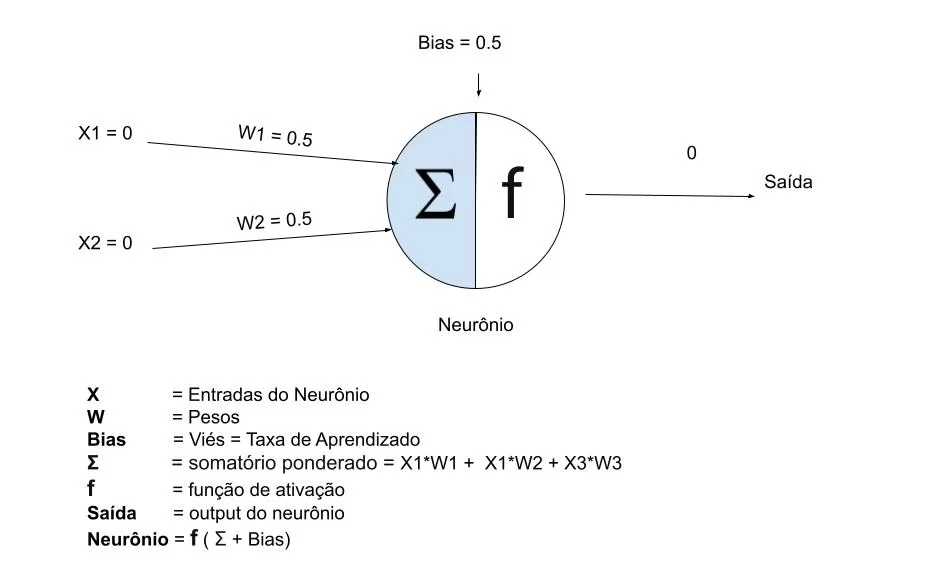

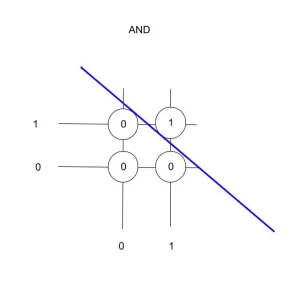

Matematicamente, a diferença é evidente nas abordagens de otimização. O Scikit-learn implementa algoritmos como Gradient Boosting, enquanto os frameworks de DL usam variações do SGD. A atualização de pesos segue:

\(\theta_{t+1} = \theta_t – \eta \nabla J(\theta_t)\)Onde theta representa os parâmetros e eta a learning rate.

Casos de Uso Recomendados

TensorFlow

- Sistemas de produção em grande escala

- Deployment em múltiplas plataformas

- Projetos que utilizam TPUs

- Aplicações empresariais com requisitos de monitoramento

PyTorch

- Pesquisa acadêmica e prototipagem rápida

- Projetos que exigem flexibilidade e debug fácil

- Implementação de arquiteturas novedosas

- Computer vision e NLP com modelos state-of-the-art

Scikit-learn

- Análise de dados tradicional e feature engineering

- Algoritmos clássicos como Random Forest e SVM

- Projetos com dados tabulares estruturados

- Introdução ao machine learning

JAX

- Pesquisa científica de alto desempenho

- Desenvolvimento de novos métodos de otimização

- Aplicações que exigem diferenciação de alta ordem

- Computação em larga escala com paralelismo eficiente

Eventualmente, a escolha depende do contexto específico. Ademais, muitos projetos utilizam combinações dessas ferramentas. Inclusive, é comum usar Scikit-learn para pré-processamento e PyTorch para modelagem profunda.

Embora existam preferências pessoais e comunitárias, todos evoluem constantemente. Analogamente, observa-se convergência de funcionalidades entre os frameworks. Afinal, o objetivo compartilhado é avançar o estado da arte em inteligência artificial.

Portanto, recomenda-se avaliar criteriosamente os requisitos do projeto antes da seleção. Igualmente, manter-se atualizado com os desenvolvimentos recentes é essencial neste campo dinâmico. Enfim, a diversidade de opções beneficia toda a comunidade, pois estimula inovação e melhoria contínua.