MACHINE LEARNING (ML) – O Aluno que Aprende com Exemplos

- É como um estudante que analisa dados históricos para fazer previsões.

- Onde brilha: Recomendações, fraudes, previsões

- Dados: Tabelas estruturadas

- Complexidade: Baixa/Média

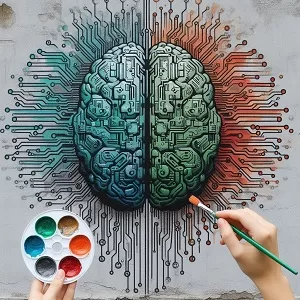

DEEP LEARNING (DL) – O Cérebro Artificial em Camadas

- É uma evolução do ML que usa redes neurais profundas – como um cérebro com múltiplas camadas de neurônios!

- Onde brilha: Imagens, voz, texto, dados complexos

- Dados: Não estruturados (fotos, áudio)

- Complexidade: Alta

Q-LEARNING (QL) – O Explorador que Aprende com Recompensas

- É o algoritmo que aprende como um jogador em um videogame – testa ações e maximiza pontuações!

- Onde brilha: Jogos, robótica, decisões sequenciais

- Dados: Ambiente interativo

- Complexidade: Média/Alta

COMO SE CONECTAM:

Imagine um carro autônomo:

ML: Preve se o motorista está cansado

DL: Reconhece pedestres e placas

QL: Aprende a melhor rota

RESUMINDO:

ML: “Aprendo com dados do passado”

DL: “Aprendo padrões complexos automaticamente”

QL: “Aprendo tentando e errando no ambiente”